Bud.ai : Une révolution dans l’apprentissage de l’anglais grâce aux Avatars

Dans mon précédent article, je vous présentais comment la combinaison de l’IA et d’un formateur virtuel permettait de créer un outil d’Adaptative Learning efficace.

Puis, nous avons répondu à quatre questions fondamentales à aborder lorsque l’on souhaite créer un bon avatar.

Maintenant, il est nécessaire et important de se pencher sur la faisabilité d’un tel projet. Et pour ça quoi de mieux que de vous présenter l’un des projets réalisés pour la startup EdaiLab ?

Mon objectif ? Vous montrer que ce n’est pas du vent. Que ça fonctionne vraiment.

a. De Speekoo à Bud.ai

Après avoir créé Speekoo, une application mobile d’apprentissage de langues via des exercices pratiques avec + 1000 000 d’utilisateurs, Etienne s’est retrouvé face à un problème difficile à résoudre.

En effet, une fois que l’on maîtrise les rudiments d’une langue, son vocabulaire, sa grammaire, sa conjugaison, il est impératif de la pratiquer à l’oral.

C’est avec cette volonté, qu’Etienne est venu à notre rencontre en décembre dernier, avec l’idée de combiner IA générative et avatar 3D, pour créer un formateur virtuel.

Autant vous dire, qu’on était super emballé. Surtout que nous avions déjà réalisé deux projets d’avatars : Reno & Ava, mais que nous n’avions pas encore adressé la formation.

Ainsi, nous avons pu combiner notre expertise sur l’IA générative et des avatars avec celle d’Etienne sur l’apprentissage des langues pour donner naissance à Bud.

b. Bud.ai, c’est quoi ?

Vous l’avez compris, Bud, c’est le 1er prof d’anglais 100% virtuel qui permet de pratiquer la langue de Shakespeare.

Concrètement, que pouvez-vous faire avec Bud ?

De nos échanges avec Etienne, il y a plusieurs approches pour apprendre la pratique d’une langue et nous en avons retranscrit trois dans l’application.

- La plus évidente permet de s’entraîner avec des exercices de grammaire ou de vocabulaire dans la même lignée que les exercices écrits.

- L’élève peut ensuite s’entraîner avec des scénarios définis. Par exemple, le classique scénario au restaurant où l’on apprend à passer une commande, demander sa note, etc… Le tout en s’appuyant sur le vocabulaire appris en amont.

- Enfin, il est possible de s’entraîner en parlant librement en anglais à Bud, sur le sujet qui nous plaît. Il faut mentionner que tous les exercices sont consignés dans la mémoire de Bud. Cela permet de proposer les bons exercices au bon moment à l’apprenant tout en ayant un vrai suivi dans le temps pour suivre sa progression.

c. Une expérience utilisateur simple et accessible.

Pourquoi selon nous Bud est la meilleure expérience d’apprentissage ?

En matière d’utilisation de nouvelles technologies dans un projet, une règle fondamentale est son accessibilité :

“L’accessibilité” d’un projet tech peut prendre plusieurs formes. Pour Bud, cela passe par :

- La disponibilité des médias : le support technique doit être détenu par le plus grand nombre. Et c’est le cas pour Bub avec +8 milliards de smartphones dans le monde ;

- La simplicité d’utilisation : poussé par les GAFAMs depuis ces 15 dernières années, le design mobile est standard et compréhensible par tous ;

D’autres facteurs permettent d’aller encore plus loin en s’appuyant sur des technologies de pointes :

- Les dernières avancées de l’IA générative qui s’améliorent tous les jours

- La qualité visuelle des avatars crée toujours plus d’empathie et aide à l’apprentissage

- La qualité des technologies actuelles de synthèses vocale et de dictée qui permettent à l’apprenant et à l’avatar de se parler de vive voix.

Et surtout, c’est fun de discuter avec une personne 100 % virtuelle.

Un projet ?

Vous souhaitez créer votre propre avatar mais vous avez besoin des conseils d’un expert ?

Contactez nousd. Comment ça fonctionne ?

Travaillant depuis 8 ans dans la tech, j’ai toujours aimé comprendre comment les choses fonctionnent.

Je pense qu’il est important de prendre une posture active pour mieux percevoir les possibilités et comprendre les limites d’une techno, pour se les approprier.

Donc si vous aussi, vous êtes un techno fan ou simplement un lecteur curieux, voici comment fonctionne Bud.ai :

1. Modéliser un avatar 3D

Un avatar 3D (personnage) est toujours composé de 4 principales composantes :

- Le modèle 3D : qui fonctionne comme une enveloppe à laquelle on peut donner n’importe quelle forme : un personnage, un robot, une forme géométrique etc.

- Ses textures : ce sont les couleurs ou matières que l’on peut retrouver sur le modèle 3D. Cela peut aller du bois au métal en passant par le tissu ou encore le caoutchouc.

- Le squelette (ou rig) : qui pour un avatar humanoïde reproduit le squelette humain et son comportement et permet d’animer un modèle 3D.

- L’animation : qui donne vie à un modèle 3D, que ce soit la marche d’une personne ou pâle d’hélicoptère qui tourne. Il y a 2 manières d’animer un modèle 3D : manuelle ou par motion capture. Oui oui comme au cinéma.

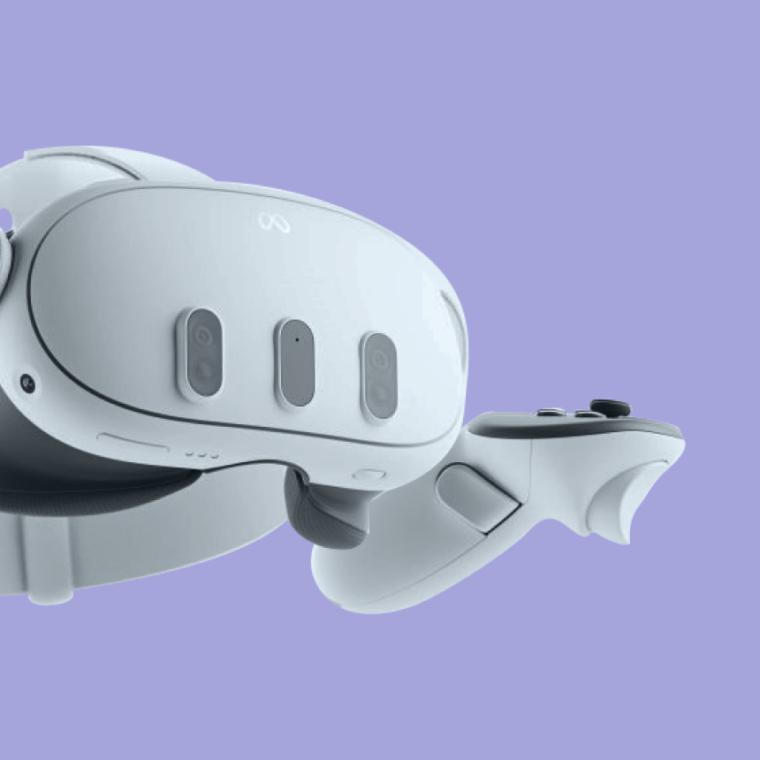

Pour Bud, nous avons utilisé notre boite à outil interne (SDK) qui nous permet de configurer n’importe quel personnage 3D, déjà riggé (ayant un squelette) et optimisé pour toutes les plateformes (web, mobile, AR, VR). Ensuite, nous l’avons animé manuellement pour simuler les interactions réelles.

2. Les interactions vocales : la nouvelle Interface Homme Machine (IHM)

Pour pouvoir dialoguer avec une machine, l’interface principale à ce jour est le combo clavier (physique ou virtuel) + texte que l’on retrouve notamment sur tous les ordinateurs et smartphones.

Depuis une dizaine d’années, une nouvelle Interface Homme Machine (ou IHM) prend de l’ampleur : la voix. D’abord dans nos smartphones puis dans nos objets connectés, cette IHM continue de s’étendre et à devenir de plus en plus « intelligente » grâce aux IA génératives.

Pour faire fonctionner ce type d’IHM on combine deux familles d’IA :

- Les IA de « Speech To Text » & « Text to Speech » comme celle de Google TTS permettent de transcrire vos paroles en texte et inversement.

- Les IA génératives comme celle d’ElevenLabs (la plus qualitative selon moi actuellement) permettent de générer une voix au plus proche de celle d’un humain.

Pour pouvoir échanger avec Bud, nous avons dû développer des connecteurs (API) à ces services afin d’en bénéficier. Il faut

noter ici que ces services sont payants et que selon le fournisseur ils peuvent être onéreux.

3. Construire le cerveau et donner du savoir

Pour qu’un avatar puisse comprendre ce que vous lui racontez et vous donner une réponse qui paraît pertinente et en adéquation avec la demande, il faut ajouter « une intelligence ». Et c’est là que les IA génératives de texte entrent en jeu.

Disclaimer : Je mets le terme « intelligence » entre guillemet car ce n’est pas une vraie intelligence capable de produire une réflexion et du savoir, mais la création d’une réponse statistiquement pertinente. Et c’est important pour la suite.

Qu’il s’agisse de Chat GPT, de Claude ou de Mistral chaque fournisseur possède ses avantages et inconvénients, mais le fonctionnement reste le même, il faut créer un prompt pertinent et intégrer le contenu adéquat.

Pour Bud, par exemple, nous lui avons donné un prompt qui contient :

- Un contexte

- Des phrases d’accueil, de relance, des interdits

- Puis des exercices d’anglais en fonction des modes choisis via différents scénarios

Et comme vu plus haut, chaque réponse sera formulée en fonction :

- De la question posée

- Du prompt

Cela permet d’avoir des réponses statiquement cadrées par rapport à un contexte donné mais unique. Créant ce sentiment d’intelligence et d’échange réel.

Enfin, qui dit formation et apprentissage dit data. En effet, il est essentiel d’offrir à ses apprenants des feedbacks de leurs échanges, de proposer des corrections et des axes d’amélioration et surtout de leur permettre de suivre leur progression.

Tout cela passe par l’analyse des données d’échanges, le fameux Machine Learning.

e. Pour aller plus loin et s’inspirer ?

Les cas application liés à l’usage des avatars virtuels sont nombreux et ont pour seule limite votre imagination.

Chez 6freeedom, on explore fortement les cas d’usage autour de la formation mais également sur des sujets variés comme le jeux-vidéo, les réseaux sociaux, l’expérience de marque etc.

Nos clients nous ont poussé à réfléchir divers sujets comme :

- L’expérience de marque avec Reno : le nouvel avatar de Renault à retrouver dans la R5 dès 2024

- Les réseaux sociaux avec Ava, le 1er avatar interactif dédié au journaling.

Découvrez Ava

Lancer un réseau social innovant avec pour pilier central, un avatar virtuel intelligent.

Aller au use case